検索エンジンが評価する信頼性とユーザーが感じる信頼性には本質的な違いがある

Webサイトの信頼性を考える際、多くの運営者が見落としがちな点があります。それは、検索エンジンが技術的に評価する信頼性と、実際にサイトを訪れるユーザーが直感的に感じる信頼性が、必ずしも一致しないという事実です。検索エンジンはアルゴリズムを通じて様々なシグナルを分析し、そのサイトが信頼に足るかを判定しようとします。一方、ユーザーは最初の数秒でサイトのデザイン、文章の読みやすさ、情報の提示方法などから瞬時に信頼性を判断しています。

この二つの信頼性評価が乖離している場合、いくら検索エンジン向けの最適化を行っても、ユーザーがすぐに離脱してしまうという問題が発生します。逆に、ユーザーには好印象を与えるサイトでも、検索エンジンが求める信頼性シグナルが不足していれば、そもそも検索結果に表示されにくくなります。真に評価されるサイトを構築するためには、両方の視点を理解し、バランスよく対応することが不可欠なのです。

検索エンジンとユーザーの両方から信頼されるサイトを構築するためには、まずそれぞれがどのような基準で信頼性を判断しているかを深く理解する必要があります。検索エンジンは数値化可能な客観的指標を重視する傾向がありますが、ユーザーはより主観的で感覚的な要素にも敏感に反応します。この違いを認識した上で、双方のニーズを満たす戦略を立てることが、長期的なサイト運営の成功につながります。

アルゴリズムが分析する信頼性シグナルの仕組み

検索エンジンのアルゴリズムは、直接的に「このサイトは信頼できる」と判断しているわけではありません。代わりに、信頼性と相関する可能性が高い様々なシグナルを収集し、総合的に評価しています。例えば、そのサイトへリンクを張っている外部サイトの質と量、サイト運営の継続期間、HTTPSによる通信の暗号化、コンテンツの更新頻度などが挙げられます。

これらのシグナルは、人間が「信頼できる」と感じる要素を数値化・定量化したものです。権威あるサイトからの被リンクが多ければ、業界内で認められている可能性が高いと推測できます。長期間運営されているサイトは、一時的な詐欺サイトである可能性が低いと考えられます。アルゴリズムはこうした推論を大規模に、高速に行うことで、膨大なWebページの中から信頼性の高いものを選別しようとしているのです。

重要なのは、これらのシグナルは間接的な指標に過ぎないという点です。被リンクが多いからといって必ずしも内容が正確とは限りませんし、HTTPSを導入しているからといって悪意のあるサイトでないとも言い切れません。検索エンジンはこうした限界を認識しつつも、利用可能なデータから最善の推測を行っているのです。サイト運営者としては、これらのシグナルを適切に満たしながら、本質的な信頼性も同時に高めていく姿勢が求められます。

アルゴリズムが重視する主な信頼性シグナルには、以下のような要素があります。

- 外部サイトからの被リンクの質と量

- HTTPSによる通信の暗号化状況

- サイトの運営継続期間と安定性

- コンテンツの更新頻度と鮮度

- ページの読み込み速度とモバイル対応

ユーザーが瞬時に判断する信頼性の要素

人間がサイトの信頼性を判断する際には、より感覚的で多面的な評価が行われます。ページを開いた瞬間のデザインの印象、広告の量や配置、文章の誤字脱字の有無、情報の具体性、運営者情報の見つけやすさなど、無意識のうちに多くの要素を統合して判断しています。

複数の調査によると、75%の消費者がウェブサイトのデザインに基づいて企業の信頼性を判断しており、最初の印象の94%はデザインに関連した要素で決まるとされています。さらに、訪問者がサイトを判断するのにかかる時間はわずか約50ミリ秒(0.05秒)であり、この極めて短い時間で信頼性の印象が形成されます。色彩に関しては、製品やウェブサイトに対する最初の印象の90%が色だけで決まるという研究結果もあります。

特に重要なのは、ユーザーの期待と実際のコンテンツのマッチングです。検索結果のタイトルやスニペットを見てクリックしたユーザーは、特定の情報を求めています。その期待に応える内容がすぐに見つかれば信頼性は高まり、見つからなければ「このサイトは期待外れだ」という印象が形成されます。この印象は離脱率やページ滞在時間という形でデータ化され、間接的に検索エンジンの評価にも影響を与える可能性があります。

品質評価ガイドラインが定める信頼性の具体的な評価項目とは

Googleは品質評価ガイドラインという文書を公開しており、その中で信頼性をどのように評価すべきかの指針を示しています。このガイドラインは検索品質評価者と呼ばれる人間の評価者に向けて書かれたものですが、Googleが何を重視しているかを理解する上で非常に参考になります。ガイドラインでは、信頼性をE-E-A-Tの中心に位置づけ、他の3要素が最終的にこの信頼性に集約されるという構造を明示しています。

信頼性の評価は、単一の指標ではなく複数の観点から総合的に行われます。コンテンツの正確性、サイト運営者の透明性、ユーザーの安全への配慮などが複合的に考慮されるのです。特にYMYL(Your Money or Your Life)に該当する分野では、この信頼性評価がより厳格に適用されることが明記されています。健康、金融、法律、ニュースなど、人々の生活に重大な影響を与える可能性のある情報を扱うサイトでは、通常よりも高い基準が求められるのです。

品質評価ガイドラインは定期的に更新されており、最新版を確認することが重要です。特に2022年12月のアップデートでExperience(経験)が追加されて以降、実体験に基づくコンテンツの価値が明確に認められるようになりました。この変更は、信頼性の評価においても「実際に経験した人が書いた情報」という観点が加わったことを意味しています。

Googleの品質評価ガイドラインでは、信頼性(Trust)をE-E-A-Tの中心に配置し、「経験、専門性、権威性はすべて、ページやウェブサイトが信頼できるかどうかの評価を支えるものである」と明記しています。つまり、他の3要素は信頼性を構成するための要素として位置づけられているのです。

個別ページレベルで評価される信頼性の指標

品質評価ガイドラインでは、各ページ単位での信頼性評価についても詳細な指針が示されています。まず重視されるのは、コンテンツの正確性です。事実と異なる情報、誤解を招く表現、根拠のない主張などが含まれていないかが確認されます。特に科学的・医学的な内容については、現在の専門家のコンセンサスと一致しているかどうかが重要視されます。

次に、コンテンツ作成者の明示も評価対象となります。誰がその情報を書いたのか、その人物はどのような背景や資格を持っているのかが明確であれば、読者はその情報をどの程度信頼すべきか判断しやすくなります。また、情報の出典や参考文献が適切に示されているかどうかも、そのページの信頼性を測る重要な指標となっています。

さらに、コンテンツの更新日時の明示も信頼性に影響します。特に変化の激しい分野では、情報がいつ書かれたものかが重要です。古い情報が更新されずに放置されている場合、現在では正確でない可能性があるためです。更新日を明示し、定期的に内容を見直していることを示すことで、読者に対する誠実さをアピールできます。また、ページ内の情報が相互に矛盾していないか、論理的に一貫しているかという点も、細部まで注意が払われているかどうかの指標として評価されます。

著者情報の明示とE-E-A-Tシグナルの強化を同時に実現するには、Schema.org準拠の構造化データを適切に実装することが重要です。以下のプラグインは、Person/Organization/Corporationの3種類の著者タイプに対応し、Article/NewsArticle/BlogPosting/WebPageスキーマを自動生成します。SNSアイコン40種以上にも対応しており、著者の専門性と権威性を検索エンジンに効果的に伝達できます。

サイト全体の信頼性を左右する要素

個別ページだけでなく、サイト全体としての信頼性も評価対象です。運営者情報ページの充実度は特に重要で、誰がそのサイトを運営しているのか、連絡先は明確か、組織としての実体はあるのかといった点が確認されます。また、プライバシーポリシーや利用規約の整備状況も、サイト運営の誠実さを示す指標として考慮されます。

サイトの評判も信頼性評価に影響を与えます。外部のレビューサイトやニュース記事などで、そのサイトや運営組織についてどのような評価がなされているかが参照されることがあります。過去にトラブルや問題を起こした履歴がある場合、それが信頼性評価に影響する可能性もあるのです。

また、サイト内のナビゲーションやユーザー体験も間接的に信頼性に関わります。必要な情報にすぐにアクセスできるか、リンク切れが放置されていないか、モバイルでも適切に表示されるかなど、サイトの管理状態が適切かどうかも評価の対象となります。これらの要素が整っていないサイトは、運営者が十分な注意を払っていないという印象を与え、信頼性の低下につながる可能性があります。さらに、サイト全体を通じて一貫したブランドイメージやメッセージを維持しているかどうかも、組織としての信頼性を判断する材料となります。

なぜ信頼性がE-E-A-Tの中心に位置づけられたのか

E-E-A-Tの図解を見ると、信頼性(Trust)は中心に配置され、経験・専門性・権威性の3要素がその周囲を取り囲む形で表現されています。これは単なるデザイン上の選択ではなく、信頼性こそがすべての評価の最終目標であることを示しています。いくら経験が豊富でも、いくら専門性が高くても、いくら権威があっても、その情報が信頼できなければ価値がないという考え方が根底にあるのです。

この構造は、2022年12月にExperience(経験)が追加された際に明確化されました。従来のE-A-Tでも信頼性は重要でしたが、4要素体制になったことで、信頼性を中心とした統合的な評価フレームワークとしての性格がより鮮明になりました。

信頼性が中心に位置する構造は、検索エンジンの本質的な目的を反映しています。検索エンジンの使命は、ユーザーが求める情報を正確かつ安全に届けることです。どれだけ詳しい情報でも、誤りが含まれていたり、ユーザーを欺く意図があったりすれば、検索エンジンとしての存在価値を損なうことになります。そのため、すべての評価要素は最終的に「信頼できるか」という問いに収束するよう設計されているのです。

経験・専門性・権威性が信頼性に収束する仕組み

経験、専門性、権威性の3要素は、それぞれ異なる角度から信頼性を支える役割を果たしています。経験は「実際に体験した人の情報は信頼できる」という観点を提供します。専門性は「その分野に詳しい人の情報は信頼できる」という観点をもたらします。権威性は「業界で認められている人や組織の情報は信頼できる」という観点を加えます。

これら3つの要素が揃うことで、総合的な信頼性が形成されるのです。例えば、ある製品についての情報を発信する場合、実際にその製品を使った経験があり、その製品分野について専門的な知識を持ち、さらに業界内で一定の認知度を持つ人物が発信する情報は、高い信頼性を持つと評価されます。逆に、どれか一つでも欠けていると、信頼性の評価は相対的に低くなる可能性があります。

重要なのは、これらの要素はすべて「信頼」という概念を別の角度から照らし出しているという点です。経験は「実際にやったことがあるから信じられる」、専門性は「詳しく知っているから信じられる」、権威性は「みんなが認めているから信じられる」というロジックで、いずれも最終的には信頼の根拠を提供しています。3つの要素を個別に強化しようとするよりも、「どうすれば読者に信頼してもらえるか」という本質的な問いから考えることで、より効果的な施策が見えてきます。

| 要素 | 信頼性への貢献 | 具体的な示し方 |

|---|---|---|

| Experience(経験) | 実体験に基づく情報の信頼性 | 実際の使用レポート、写真、具体的なエピソード |

| Expertise(専門性) | 専門知識による情報の正確性 | 資格、学歴、専門分野での実績 |

| Authoritativeness(権威性) | 業界での認知による情報の重み | 被リンク、メディア掲載、業界団体との関係 |

誤情報拡散防止という社会的要請への対応

信頼性が中心に据えられた背景には、インターネット上での誤情報拡散という深刻な社会問題があります。特に健康、政治、金融などの分野において、不正確な情報や意図的な偽情報が広まることで、実際に人々の生活や安全に悪影響が及ぶケースが増えています。検索エンジンは情報へのアクセス手段として広く使われているため、その検索結果の品質は社会的な責任を伴います。

2024 Edelman Trust Barometerの調査によると、情報戦争への恐れを感じる人の割合は61%に達し、前年から6ポイント上昇しています。また、ジャーナリストが意図的に誤った情報を発信していると考える人は64%、政府指導者については63%、ビジネスリーダーについては61%という結果が出ています。このような社会的な情報への不信感の高まりを受け、Googleが信頼性を重視する姿勢を明確にしたことは、この社会的要請への対応という側面があります。

コロナ禍を経て、オンライン情報の影響力と危険性が広く認識されるようになりました。医療に関する誤情報が健康被害を引き起こしたり、政治に関する偽情報が社会の分断を深めたりする事例が相次いだことで、情報の信頼性に対する社会全体の意識が高まっています。検索エンジンは中立的な情報仲介者として、この問題に対処する責任を負っており、信頼性を評価の中心に据えることは、その責任を果たすための必然的な選択といえます。

サイトの種類によって求められる信頼性の基準は異なる

すべてのWebサイトに同じ信頼性基準が適用されるわけではありません。サイトの目的、提供する情報の性質、想定される利用者によって、求められる信頼性のあり方は大きく変わってきます。ニュースサイトと趣味のブログでは、当然ながら求められる厳格さのレベルが異なります。この違いを理解せずに一律の対策を行っても、効果は限定的になってしまいます。

品質評価ガイドラインでもこの点は考慮されており、サイトの種類や扱うトピックに応じた評価基準の違いが示されています。自社サイトがどのカテゴリに属し、どのような信頼性基準が適用される可能性があるかを把握することが、効果的な対策の第一歩となります。

信頼性基準の違いは、情報の誤りがもたらす影響の大きさに比例しています。医療情報の誤りは健康被害につながる可能性があり、金融情報の誤りは経済的損失を招く恐れがあります。一方、エンターテインメントコンテンツの軽微な事実誤認は、それほど深刻な影響をもたらしません。検索エンジンはこうした影響度の違いを考慮し、YMYL領域ではより厳格な基準を適用しているのです。自社サイトがYMYL領域に該当するかどうかを正確に判断し、適切なレベルの信頼性対策を講じることが重要です。

Google Search Centralのドキュメントでは、E-E-A-Tについて「検索結果の品質を評価する際に考慮される多くの要素の一部」と説明しています。また、E-E-A-Tは直接的なランキング要素ではないものの、E-E-A-Tが優れたコンテンツを特定するために有用であると述べています。

情報提供を主目的とするサイトに求められる信頼性

ニュースサイト、専門情報サイト、教育コンテンツを提供するサイトなど、情報提供を主目的とするサイトでは、コンテンツの正確性と出典の明示が特に重視されます。読者はそのサイトの情報を事実として受け取る可能性が高いため、誤った情報を提供することの影響は大きくなります。

このカテゴリのサイトでは、著者の専門性を明示すること、情報の根拠を示すこと、定期的に内容を更新して最新性を保つことが重要です。また、特定の立場や意見を持つ場合は、それを明確にすることで読者が情報を適切に解釈できるようにすることも、誠実な情報提供の一部と考えられています。

情報提供サイトでは、編集方針やファクトチェックのプロセスを公開することも信頼性向上に寄与します。どのような基準で情報を選定し、どのような確認作業を経て公開しているかを明示することで、読者は情報の信頼度を判断しやすくなります。また、誤りが発見された場合の訂正ポリシーを定め、透明性を持って対応することも重要です。過去の訂正履歴を公開しているサイトは、誠実な姿勢を示すことができます。読者からのフィードバックを受け付け、必要に応じて内容を改善する仕組みも、信頼性の高いサイト運営には欠かせない要素です。

商品やサービスを提供するサイトに求められる信頼性

ECサイトやサービス提供サイトでは、情報の正確性に加えて、取引の安全性という観点からの信頼性も重要になります。ユーザーは個人情報や決済情報を入力することになるため、そのデータが適切に保護されるかどうかは大きな関心事です。

PwCが2024年1〜2月に31カ国20,662人を対象に実施した消費者調査によると、企業への信頼を構成する最も重要な要素として、データ保護を挙げた人が83%で最多でした。続いて商品・サービスの品質が79%、従業員の扱いが77%、価格の手頃さが75%という結果になっています。ECサイトでは、会社情報の明示、特定商取引法に基づく表記の充実、セキュリティ対策の実施状況、返品・返金ポリシーの明確化などが信頼性評価に関わってきます。

商品やサービスを提供するサイトでは、カスタマーサポートの充実度も信頼性の重要な指標となります。問い合わせへの応答速度、対応の丁寧さ、問題解決能力などが、そのサイトへの信頼に直接影響します。また、実際の顧客レビューを適切に管理し、ネガティブなレビューにも誠実に対応する姿勢を見せることで、透明性と信頼性をアピールできます。価格表示の明確さ、送料や手数料の事前告知、配送状況の追跡機能の提供なども、取引における信頼性を高める要素として重要です。

信頼性を損なう行為とそれがもたらすリスク

信頼性を高める努力と同様に重要なのが、信頼性を損なう行為を避けることです。意図的であるかどうかに関わらず、特定の行為はサイトの信頼性評価を著しく低下させる可能性があります。一度失われた信頼を取り戻すには、構築する以上の時間と労力が必要になるため、予防的な観点からもこれらの行為を理解しておくことが重要です。

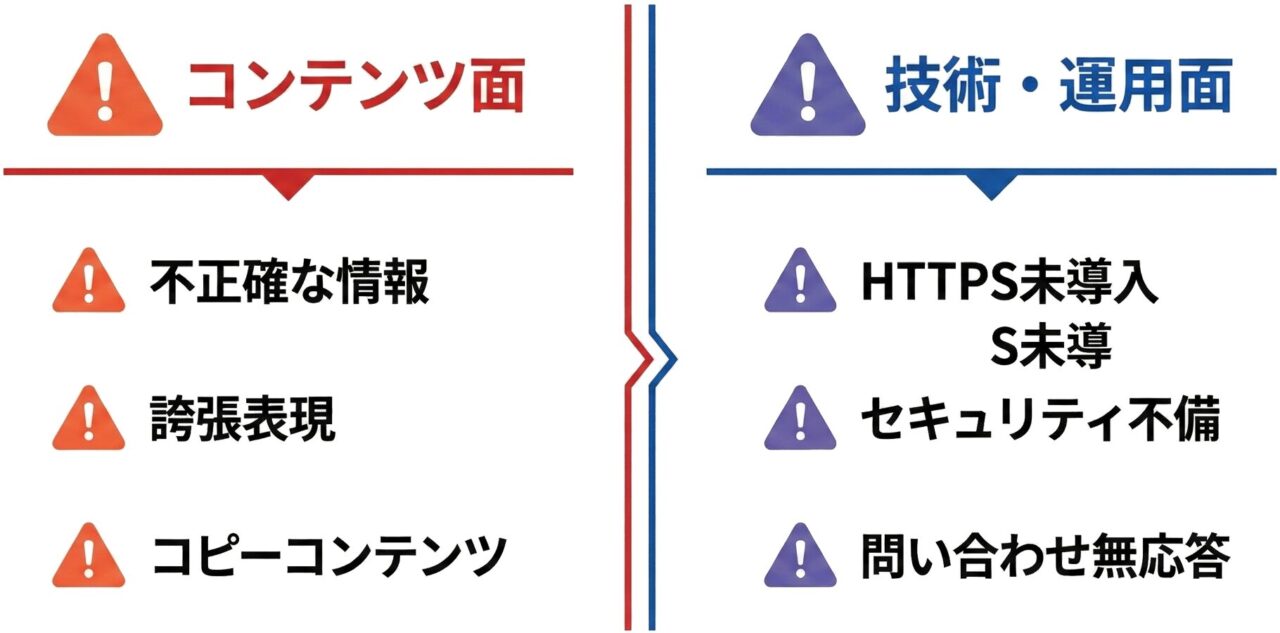

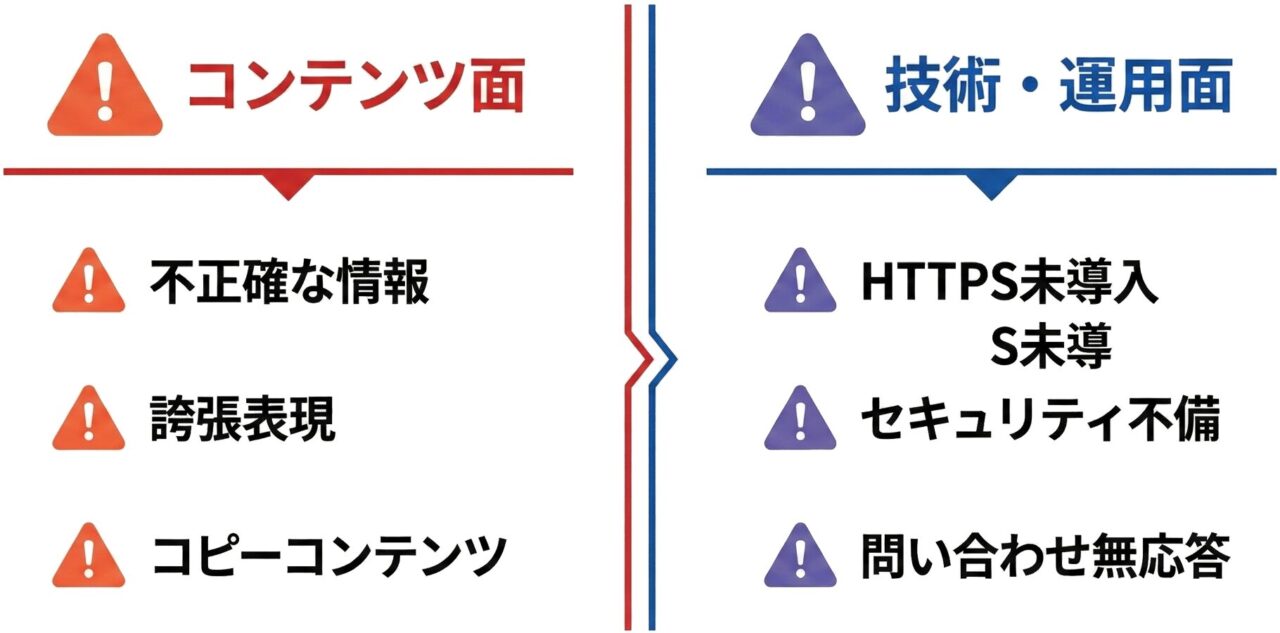

信頼性を損なう行為は、コンテンツに関するものと、技術・運用に関するものに大別できます。どちらも同様に重要であり、片方だけに注意を払っても不十分です。

信頼性の毀損は、検索エンジンからの評価低下だけでなく、ブランド全体への悪影響にもつながります。一度「信頼できない」という印象を持たれると、そのイメージを払拭するには膨大な努力が必要です。SNSでの悪評の拡散、口コミでのネガティブな評価など、信頼性の低下は様々な形で事業に打撃を与えます。また、法的なリスクも考慮する必要があります。虚偽の情報を提供したり、ユーザーを欺くような行為を行ったりした場合、法的責任を問われる可能性もあるのです。信頼性を損なう行為は、短期的な利益と引き換えに長期的な損失をもたらす危険な選択といえます。

コンテンツ面で信頼性を低下させる要因

コンテンツ面での信頼性低下要因として最も深刻なのは、不正確な情報や誤解を招く表現の掲載です。事実確認を怠った情報、古くなった情報の放置、根拠のない主張などは、読者の信頼を裏切ることになります。特に健康や金融に関する情報では、誤った情報が実害につながる可能性もあるため、細心の注意が必要です。

また、過度に誇張した表現や、クリックを誘うだけのタイトル、本文とタイトルの不一致なども信頼性を損なう要因となります。短期的にはアクセス数を稼げるかもしれませんが、期待外れだったユーザーはそのサイトを二度と訪れなくなる可能性が高く、長期的にはマイナスの影響をもたらします。

コピーコンテンツや他サイトからの無断転載も、深刻な信頼性低下要因です。オリジナリティのないコンテンツは検索エンジンから低く評価されるだけでなく、著作権侵害として法的問題に発展する可能性もあります。また、AIで大量生成された低品質なコンテンツも、信頼性を損なう要因として認識されつつあります。量より質を重視し、読者に真の価値を提供できるコンテンツを作成することが、長期的な信頼構築には不可欠です。

コンテンツ面で特に注意すべき信頼性低下要因としては、以下の項目が挙げられます。

- 事実確認を怠った不正確な情報の掲載

- 古くなった情報を更新せず放置すること

- 根拠や出典を示さない主張

- クリックベイトや誇張されたタイトル

- 本文とタイトルの内容不一致

技術・運用面で信頼性を低下させる要因

技術面では、HTTPSを導入していないこと、セキュリティ対策が不十分であること、個人情報の取り扱いが不明確であることなどが信頼性を低下させます。特にユーザーの情報を扱うサイトでは、セキュリティ対策の不備は致命的な信頼失墜につながりかねません。

運用面では、問い合わせへの無応答、古い情報の放置、リンク切れの放置、サイトの不安定な稼働なども信頼性に悪影響を与えます。また、運営者情報が不明確であったり、連絡手段が提供されていなかったりすることも、サイトの信頼性を疑わせる要因となります。ユーザーは何か問題が起きた時に対応してもらえるかどうかを気にしており、その窓口が見えないことは不安要素となるのです。

リンク切れはユーザー体験を損なうだけでなく、サイト管理が行き届いていない印象を与え、信頼性評価に悪影響を及ぼします。以下のプラグインは、軽量なHEADリクエストを使用してサイト内のすべてのリンクをスキャンし、問題のあるリンクをインタラクティブなプレビュー機能で視覚的に特定できます。個別・一括再チェックやスマートキャッシュにも対応しています。

サイトの表示速度が遅いことも、間接的に信頼性の印象を損なう要因となります。読み込みに時間がかかるサイトは、技術力の不足やリソース投資の不十分さを連想させ、プロフェッショナルでないという印象を与えかねません。また、スマートフォンでの表示が崩れる、特定のブラウザで正常に動作しないといった互換性の問題も、サイトの品質への疑問を招きます。広告の過剰な表示や、ユーザーの操作を妨げるポップアップなども、ユーザー体験を損ない、信頼性の低下につながる要因です。

| カテゴリ | 信頼性低下要因 | 影響度 |

|---|---|---|

| コンテンツ | 不正確な情報・誤解を招く表現 | 高 |

| コンテンツ | クリックベイト・誇張タイトル | 中〜高 |

| 技術面 | HTTPSの未導入 | 高 |

| 技術面 | セキュリティ対策の不備 | 高 |

| 運用面 | 問い合わせへの無応答 | 中 |

| 運用面 | 運営者情報の不明確さ | 中〜高 |

ユーザーの行動データが信頼性シグナルとして機能する仕組み

検索エンジンは、ユーザーが検索結果をクリックした後の行動からも情報を収集しています。直接的に信頼性を測定しているわけではありませんが、ユーザー行動のパターンは間接的に信頼性を示すシグナルとして機能している可能性があります。高い信頼性を持つサイトは、ユーザーから好意的な行動反応を得やすいからです。

ただし、ユーザー行動データの解釈には注意が必要です。短い滞在時間が必ずしも低品質を意味するわけではなく、求める情報をすぐに見つけられた結果かもしれません。重要なのは、ユーザーの検索意図に適切に応えているかどうかであり、単純な数値だけで判断することはできません。

検索エンジンがユーザー行動データをどの程度ランキングに活用しているかは公式には明らかにされていませんが、間接的な形で評価に影響を与えている可能性は高いと考えられています。特に、同じクエリで検索結果に戻って別のサイトをクリックする行動(ポゴスティッキング)が頻発する場合、そのサイトがユーザーのニーズを満たしていないというシグナルとなり得ます。一方で、検索後に同じクエリで再検索しない「ラストクリック」となるサイトは、ユーザーを満足させた可能性が高いと推測できます。

エンゲージメント指標と信頼性の相関関係

ページ滞在時間、ページ閲覧数、スクロール深度などのエンゲージメント指標は、ユーザーがそのコンテンツにどの程度関心を持ったかを示します。信頼できると感じたサイトでは、ユーザーはより長く滞在し、より多くのページを閲覧し、より深くコンテンツを読み込む傾向があります。

逆に、信頼性に疑問を感じたサイトでは、ユーザーはすぐに離脱して別のサイトを探す行動をとります。この「ポゴスティッキング」と呼ばれる行動パターンが頻繁に発生する場合、そのサイトはユーザーの期待に応えられていないというシグナルになり得ます。ただし、検索エンジンがこれらの指標をどの程度、どのように使用しているかは公式には明らかにされていません。

エンゲージメント指標を改善するためには、コンテンツの質を高めることが最も効果的です。読者が求める情報を的確に提供し、読みやすい文章構成と視覚的に魅力的なデザインを組み合わせることで、自然とエンゲージメントは向上します。また、関連コンテンツへのリンクを適切に配置したり、記事の冒頭で内容の概要を示したりすることも、ユーザーの滞在を促す効果があります。重要なのは、数値を上げることを目的とするのではなく、ユーザーに価値を提供した結果として指標が改善されるという順序を意識することです。

ユーザーがサイトの信頼性に不安を感じた場合の行動パターンは、以下の形で現れます。

- 探している情報が5秒以内に見つからないと離脱する傾向

- ページの読み込み時間が3秒を超えると離脱率が大幅に上昇

- デザインや情報の信頼性に疑問を感じると即座に検索結果に戻る

- 複数のサイトを比較検討し、より信頼できそうなサイトを選択

再訪問や外部からの参照が示す信頼の証

より強力な信頼性シグナルとなり得るのが、リピート訪問と外部サイトからの参照です。一度訪れたユーザーが再び戻ってくるということは、最初の訪問で信頼に足る価値を提供できたことの証拠です。ブックマークへの追加や、ブランド名での直接検索なども、そのサイトへの信頼を示す行動と解釈できます。

外部サイトからのリンクも重要な信頼性シグナルです。他のサイト運営者がリンクを張るということは、そのコンテンツを推薦に値すると判断したことを意味します。特に、関連分野の権威あるサイトからのリンクは、業界内での信頼を示す強力な証拠となります。

リピート訪問を増やすためには、初回訪問時に強い印象を残すことが重要です。有益な情報を提供することはもちろん、サイトの名前やブランドを記憶に残る形で提示することも効果的です。メールマガジンの登録やSNSでのフォローを促すことで、継続的な関係を構築する機会を作ることもできます。外部からのリンクについては、他サイトが参照したくなるようなオリジナルのデータ、独自の調査結果、網羅的なガイドなど、引用価値の高いコンテンツを作成することが基本です。業界内でのネットワーキングや、専門家としての情報発信も、自然な形でリンクを獲得する方法として有効です。

一度低下した信頼性を回復するためのアプローチ

サイトの信頼性が何らかの理由で低下してしまった場合、それを回復することは可能ですが、時間と継続的な努力が必要です。信頼は一朝一夕で築けるものではなく、同様に一度の改善で回復できるものでもありません。問題の原因を特定し、適切な対策を講じ、それを継続することで、徐々に信頼を取り戻していくことができます。

回復のプロセスでは、まず何が信頼性低下の原因となったかを正確に把握することが重要です。漠然と改善を試みても効果は限定的です。問題を具体的に特定し、優先順位をつけて対処していくことが、効率的な回復への道となります。

信頼性回復においては、誠実な姿勢を示すことが何よりも大切です。問題を隠蔽したり、言い訳をしたりするのではなく、正面から向き合い、改善に取り組む姿勢を見せることで、徐々に信頼を取り戻すことができます。場合によっては、過去の問題について公式に説明し、謝罪することが必要になるかもしれません。透明性を持って対応することは、短期的には痛みを伴うかもしれませんが、長期的には信頼回復の近道となります。

Googleのジョン・ミューラー氏は、品質の問題を修正した後の回復について「サイトが本当に良くなったことをアルゴリズムが認識するには時間がかかる」と述べています。また、コアアップデートの影響を受けた場合は、次のコアアップデートまで大きな変化が見られないこともあると説明しています。

問題のあるコンテンツの特定と改善方法

まず行うべきは、サイト内のコンテンツを網羅的に確認し、問題のあるページを特定することです。不正確な情報、古くなった情報、根拠の不明確な主張、品質の低いコンテンツなどをリストアップします。これらに対して、修正、更新、または削除といった対応を行います。

改善の際には、単に問題を修正するだけでなく、なぜその問題が発生したかのプロセスも見直すことが重要です。同じ問題が再発しないよう、コンテンツ作成のガイドラインや品質チェックの仕組みを整備することで、長期的な信頼性維持につなげることができます。

コンテンツ監査を効率的に行うためには、系統的なアプローチが必要です。まず全ページのリストを作成し、最終更新日、トラフィック、バウンス率などの指標とともに整理します。特に注意が必要なのは、YMYL領域に該当するコンテンツと、アクセス数は多いが品質に懸念があるページです。優先順位をつけて順番に確認し、問題のあるページについては「更新」「大幅改訂」「削除」のいずれかの対応を決定します。改善作業の進捗を記録し、定期的にレビューすることで、継続的な品質管理が可能になります。

継続的な信頼構築のための長期的施策

一時的な問題修正だけでなく、継続的に信頼を構築していくための施策も必要です。定期的なコンテンツ監査、ユーザーからのフィードバックへの対応、業界の変化に合わせた情報更新など、運用面での取り組みが求められます。

また、サイト外での評判構築も信頼回復に寄与します。業界メディアへの寄稿、専門家としての情報発信、他サイトとの健全な関係構築などを通じて、外部からの信頼シグナルを増やしていくことができます。信頼回復は長いプロセスですが、誠実に取り組むことで必ず成果につながります。

長期的な信頼構築のためには、組織全体での品質意識の向上が不可欠です。コンテンツ作成に関わるすべてのメンバーが、信頼性の重要性を理解し、日々の業務の中で実践できるよう、教育やトレーニングを行うことが効果的です。また、品質管理のためのチェックリストやワークフローを整備し、一貫した品質を維持できる体制を構築することも重要です。定期的に外部の専門家によるレビューを受けることで、内部では気づきにくい問題を発見することもできます。信頼構築は終わりのないプロセスであり、常に改善を続ける姿勢が求められます。

検索アルゴリズムの進化に伴う信頼性評価の将来展望

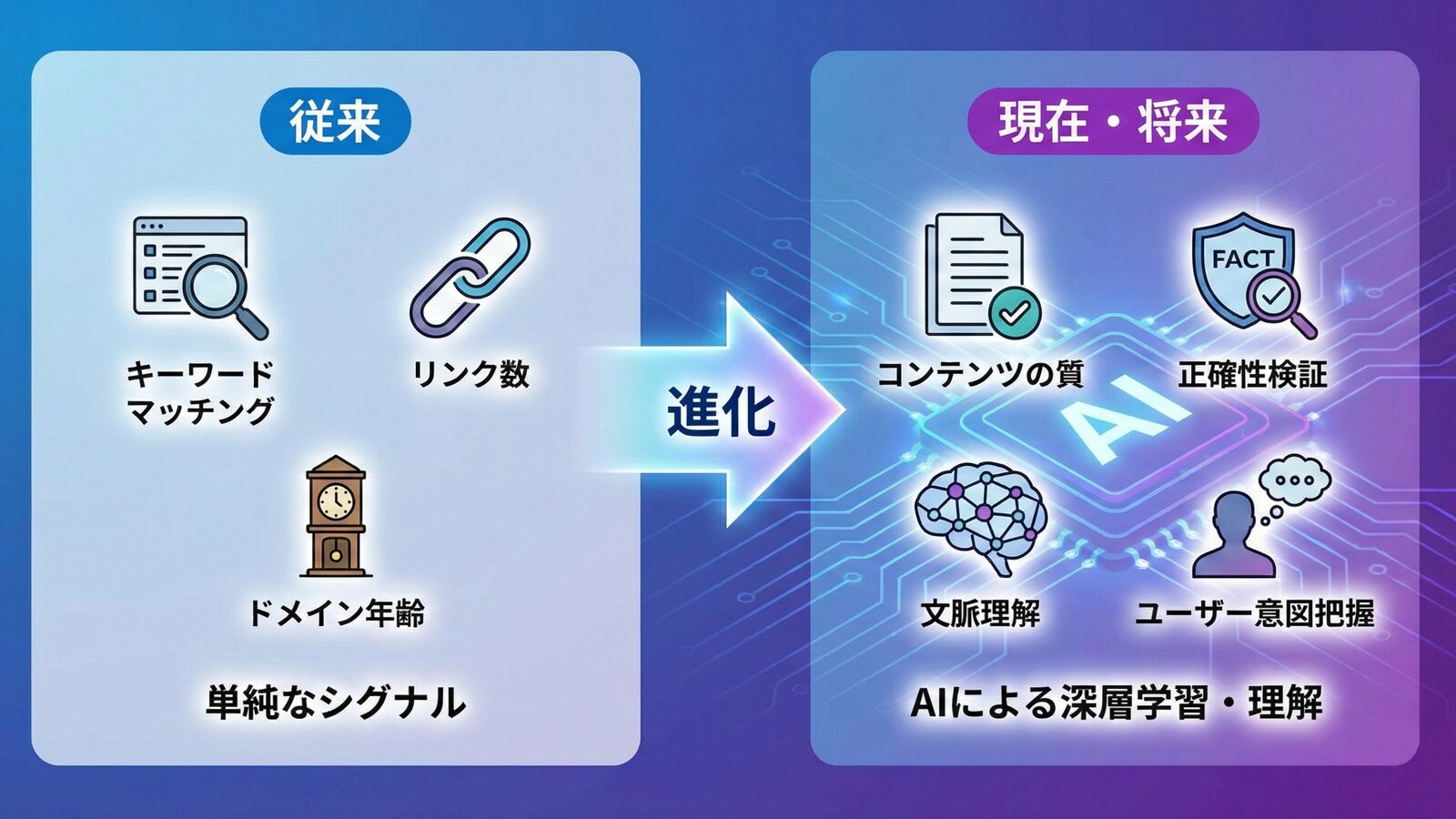

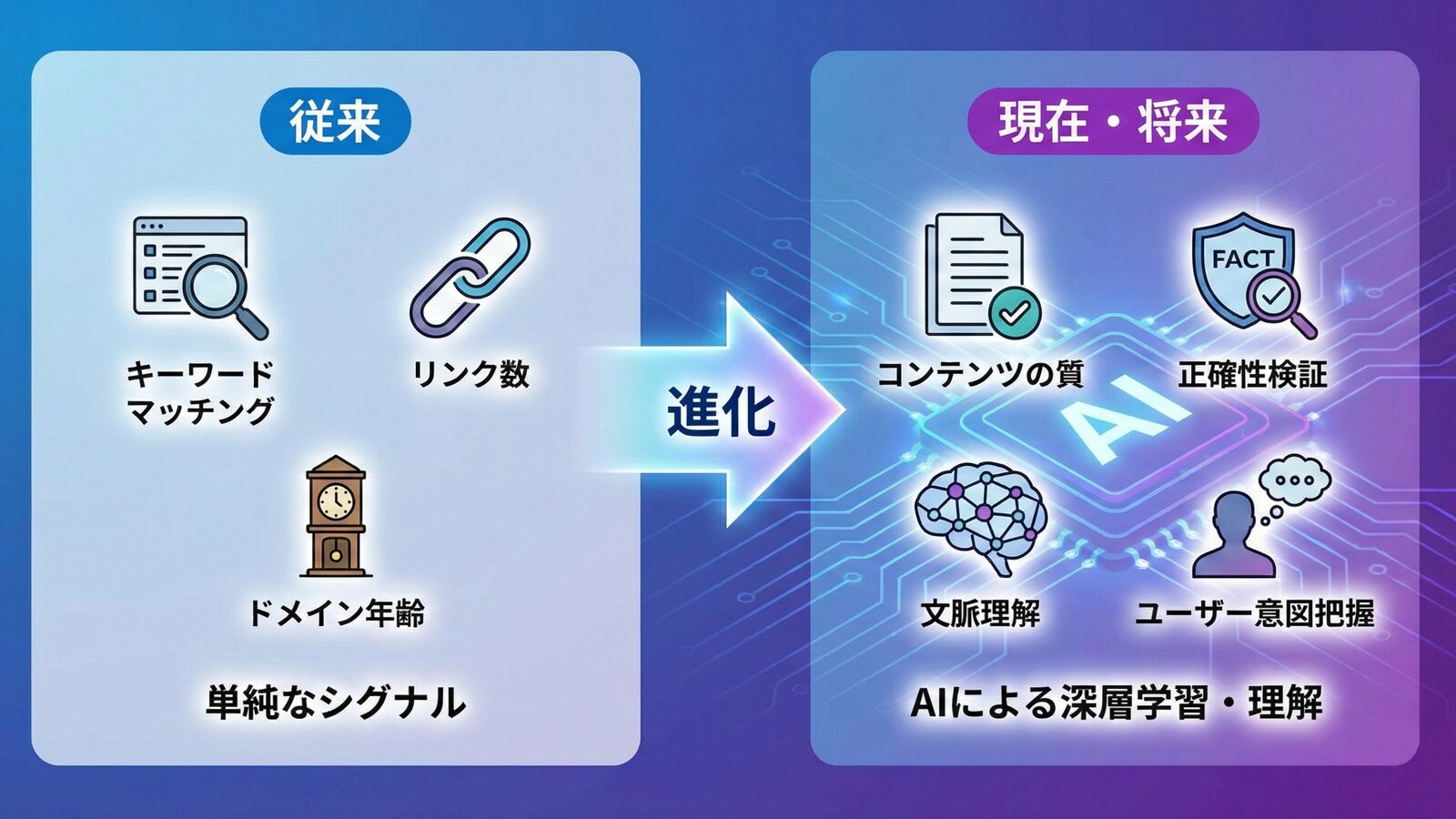

検索アルゴリズムは常に進化を続けており、信頼性の評価方法も年々高度化しています。AIと機械学習の発展により、以前は困難だった信頼性シグナルの検出や分析が可能になりつつあります。この流れは今後も続くと予想され、より精緻な信頼性評価が行われるようになるでしょう。

同時に、生成AIによるコンテンツ作成が普及する中で、情報の信頼性を担保することの重要性はさらに高まっています。AIが作成したコンテンツが検索結果に溢れる時代において、人間の経験や専門性に裏打ちされた信頼できる情報の価値は、むしろ上昇すると考えられます。

オンラインレビューに関するBrightLocalの2024年調査によると、オンラインレビューを友人や家族からの個人的な推薦と同程度に信頼する消費者は49%となっています。この数値は2020年の79%から大幅に低下しており、オンライン情報全般への信頼が揺らいでいることを示しています。このような環境下で、真に信頼できる情報源としての地位を確立することは、これまで以上に価値を持つようになっています。

検索エンジンの進化は、表面的なSEO対策の効果を低下させる方向に進んでいます。テクニカルな最適化だけでは差別化が難しくなり、コンテンツの本質的な価値がより重要になってきています。この傾向は今後さらに強まると予想され、信頼性の高いコンテンツを持続的に作成できる体制を構築することが、長期的な競争力の源泉となるでしょう。

AIによる信頼性判定の高度化がもたらす変化

大規模言語モデルや高度な自然言語処理技術の発展により、検索エンジンはコンテンツの内容をより深く理解できるようになっています。単にキーワードの一致を見るだけでなく、情報の正確性、論理の一貫性、主張の根拠の妥当性などを評価する能力が向上しています。

この進化は、表面的な最適化テクニックの効果を低下させる一方で、本質的に信頼できるコンテンツの評価を高めることにつながります。小手先のSEO対策ではなく、読者にとって真に価値のある信頼できる情報を提供することが、これまで以上に重要になっていくのです。信頼性への投資は、アルゴリズムの変化に左右されにくい、持続可能なSEO戦略の基盤となります。

AIの発展は、検索エンジン側だけでなく、コンテンツ作成側にも大きな変化をもたらしています。生成AIを活用したコンテンツ作成が容易になる中、人間ならではの価値をどのように提供するかが問われています。実体験に基づく独自の視点、専門家としての深い洞察、読者のニーズを理解した的確な情報提供など、AIでは代替できない要素を強化することが重要です。また、AIを適切にツールとして活用しながら、最終的な品質と信頼性は人間が責任を持って担保するという姿勢が、これからの時代には求められるでしょう。信頼性は人間が構築し、維持するものであり、その本質はテクノロジーが進化しても変わりません。

よくある質問